מכונה עצבית תרגום מאפשר חידושים אנושיים בענן

במרץ 2018 אנחנו ודיעה (חסן ואח ' 2018) תוצאה פורצת דרך שבה הצגנו בפעם הראשונה מערכת תרגום מכונה שיכולה לבצע כמו גם מתרגמים אנושיים (בתרחיש ספציפי – תרגום חדשות בסינית-אנגלית). זו הייתה פריצת דרך מרגשת במחקר תרגום מכונה, אבל המערכת שבנינו עבור פרויקט זה היה מערכת מורכבת, מחקר כבד, שילוב טכניקות חדשניות מרובות. בזמן שאנחנו שיחררו את הפלט של מערכת זו על כמה מערכות בדיקה, המערכת עצמה לא היתה מתאימה לפריסה בזמן אמת תרגום מכונה ענן API.

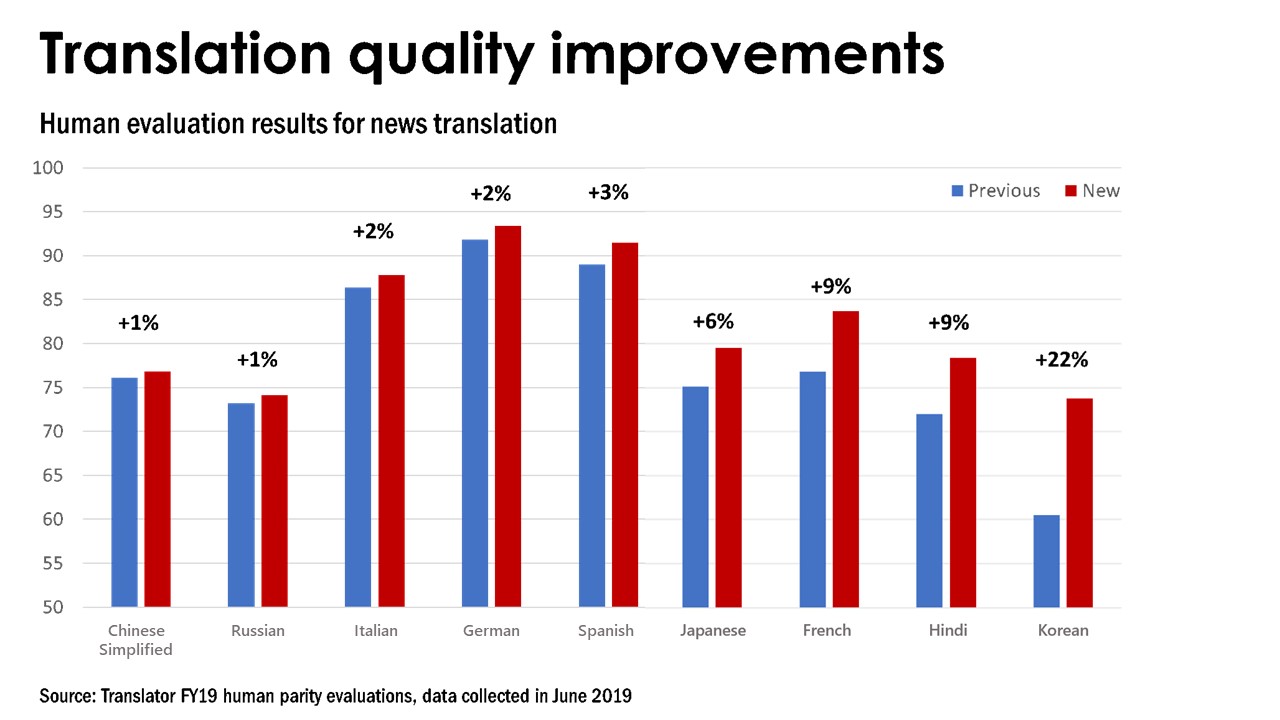

היום אנו נרגשים להכריז על זמינות בייצור של הדור האחרון שלנו של מודלים עצביים מכונה. מודלים אלה משלבים את מרבית הטוב של מערכת המחקר שלנו וזמינים כעת כברירת מחדל בעת שימוש ב-API של מתרגם Microsoft. מודלים חדשים אלה זמינים כיום בסינית, גרמנית, צרפתית, הינדית, איטלקית, ספרדית, יפנית, קוריאנית, רוסית, מ ולאנגלית. . עוד שפות מגיעות בקרוב

הגעה מעבודת מחקר לענן API

במהלך השנה האחרונה, חיפשנו דרכים להביא הרבה מהאיכות של מערכת זוגיות אנושית לתוך Microsoft מתרגם API, תוך שהיא ממשיכה להציע תרגום בזמן אמת נמוך. . הנה כמה מהשלבים במסע הזה

הכשרת מורים-סטודנטים

הצעד הראשון שלנו היה לעבור למסגרת "מורה-תלמיד", בה אנו מאמנים תלמיד בזמן אמת קל לחקות רשת מורים במשקל כבד (בה וקראנה 2014). זה מושגת על ידי הכשרת התלמיד לא על הנתונים מקבילים כי MT מערכות מאומנים בדרך כלל, אבל על תרגומים שיוצרו על ידי המורה (קים וראש 2016). זוהי משימה פשוטה יותר מאשר לימוד מתוך נתונים גולמיים, ומאפשרת הוראה, תלמיד פשוט יותר בקרוב מאוד לאחר המורה המורכב. כפי שאפשר לצפות, ניסיונות הראשונית שלנו עדיין סבלו טיפות איכות מהמורה לתלמיד (אין ארוחת צהריים חינם!), אבל בכל זאת לקחנו את המקום הראשון ב-WNMT 2018 משימה משותפת על פענוח יעיל (. ג'ונצ-דמונט ואח ' אל 2018). כמה תוצאות מרגש במיוחד מהמאמץ הזה היו כי שנאי (ואסיאני ואח ' 2017) המודלים והשינויים שלהם משחקים היטב עם הכשרת מורים-סטודנטים והם יעילים בצורה מהדהדת במהלך היסק במעבד.

לימוד מתוצאות ראשוניות אלה ולאחר איטרציה הרבה גילינו מתכון שמאפשר לתלמיד הפשוט שלנו להיות כמעט באותה איכות כמו המורה המורכב (לפעמים יש ארוחת צהריים חינם אחרי הכל?). עכשיו היינו חופשיים לבנות מודלים גדולים ומורכבים כדי למקסם את האיכות, מבלי לחשוש מאילוצי זמן אמת (יותר מדי).

תרגום בזמן אמת

ההחלטה שלנו לעבור למסגרת מורה-תלמיד הייתה מונעת על ידי העבודה הגדולה של קים וראש (2016) עבור מודלים פשוטים מבוססי RNN. בשלב זה לא היה ברור אם היתרונות דיווחו היה להתבטא גם מודלים שנאי (ראה ואסיאני ואח ' 2017 לפרטים על מודל זה). אך במהרה גילינו שזה אכן המקרה.

התלמיד שנאי יכול להשתמש באלגוריתם פענוח פשוט מאוד (חיפוש חמדן) שבו אנחנו פשוט לבחור את המילה המתורגמת הטובה ביותר בכל שלב, ולא את השיטה הרגילה (קרן חיפוש) אשר כרוכה בחיפוש דרך מרחב ענק של אפשרי תרגומים. שינוי זה היה באיכות מינימלית השפעה אבל הוביל שיפורים גדולים במהירות התרגום. לעומת זאת, מודל המורה יסבול ירידה משמעותית באיכות כאשר מעבר מ-החיפוש אחר מבול-חיפוש חמדן.

באותו הזמן, הבנו כי במקום להשתמש בארכיטקטורה העצבית האחרונה (שנאי עם תשומת לב עצמית) במפענח, ניתן לשנות את התלמיד כדי להשתמש בארכיטקטורה פשוטה ומהירה יותר של חוזרים ונשנים (RNN). זה משנה כי בעוד מקודד שנאי יכול להיות מחושב על משפט המקור כולו במקביל, משפט היעד נוצר מילה אחת בכל פעם, כך מהירות המפענח יש השפעה גדולה על המהירות הכוללת של תרגום. בהשוואה לתשומת לב עצמית, המפענח חוזר ונשנה מפחית את המורכבות האלגוריתמית מפונקציה ריבועית ועד ליניארית באורך משפט היעד. במיוחד בהגדרה של מורה-תלמיד, לא ראינו הפסד באיכות בשל שינויים אלה, לא עבור אוטומטי ולא עבור תוצאות ההערכה האנושית. כמה שיפורים נוספים כגון שיתוף פרמטרים הובילו לצמצום נוסף במורכבות ובמהירות מוגברת.

יתרון נוסף של המסגרת מורה-תלמיד היינו נרגשים מאוד לראות הוא כי שיפורים באיכות לאורך זמן של מורים הגוברת ומשתנה בקלות נישאים על הארכיטקטורה שאינה משתנה סטודנט. במקרים בהם ראינו בעיות בהקשר זה, עליות קלות בקיבולת המודל של הסטודנט יסגרו את הפער שוב.

למידה כפולה

התובנה המפתח מאחורי למידה כפולה (הוא ואח ' 2016) הוא "תרגום הלוך ושוב" לבדוק שאנשים משתמשים לעיתים כדי לבדוק איכות תרגום. נניח שאנו משתמשים במתרגם מקוון כדי לעבור מאנגלית לאיטלקית. , אם לא נקרא איטלקית? איך נדע אם הוא עשה עבודה טובה לפני הלחיצה על שלוח בדוא ל, אנחנו יכולים לבחור לבדוק את האיכות על ידי תרגום האיטלקי בחזרה לאנגלית (אולי באתר אינטרנט אחר). אם האנגלית אנו מקבלים חזרה סטה רחוק מדי מן המקור, הסיכויים הם אחד התרגומים ירד מהפסים.

למידה כפולה משתמשת באותה גישה להכשיר שתי מערכות (למשל אנגלית-> איטלקית ו איטלקית-> אנגלית) במקביל, באמצעות תרגום הלוך ושוב ממערכת אחת כדי להבקיע, לאמת ולהכשיר את המערכת האחרת.

למידה כפולה הייתה תורמת מרכזית לתוצאות המחקר של זוגיות אנושית. בדרך ממערכת המחקר למתכון הייצור שלנו, אנו כללית גישה זו באופן רחב. לא רק שיתוף זוגות של מערכות בפלט אחד של השני, השתמשנו גם באותו קריטריון לסינון הנתונים המקבילים שלנו.

ניקוי נתונים לא מדויקים

מערכות תרגום מכונה מאומנים על "נתונים מקבילים", כלומר זוגות של מסמכים התרגומים זה לזה, שנוצרו באופן אידיאלי על ידי מתרגם אנושי. כפי שהתברר, נתונים מקבילים אלה מלאים לעתים קרובות בתרגומים לא מדויקים. לפעמים המסמכים אינם מקבילים באמת, אלא רק פרפרזות משוחררות זה מזה. מתרגמים אנושיים יכולים לבחור להשאיר חומר מקור או להוסיף מידע נוסף. הנתונים יכולים להכיל שגיאות הקלדה, טעויות כתיב, טעויות דקדוק. לפעמים אלגוריתמים כריית הנתונים שלנו שולל נתונים דומים אך לא מקבילים, או אפילו על ידי משפטים בשפה הלא נכונה. הגרוע מכל, הרבה מדפי האינטרנט שאנו רואים הם דואר זבל, או למעשה להיות תרגומי מכונה ולא תרגומים אנושיים. מערכות עצביות רגישות מאוד לסוג זה של חוסר דיוק בנתונים. מצאנו כי בניית מודלים עצביים כדי לזהות באופן אוטומטי להיפטר אי-דיוקים אלה נתן שיפורים חזקים באיכות המערכות שלנו. הגישה שלנו לסינון הנתונים הביאה למקום הראשון ב WMT18 מקבילית מסנן בחינת ביצועים (Junczys-Dowmunt 2018a) וסייעו בבניית אחת ממערכות התרגום האנגליות-גרמניות החזקות ביותר ב WMT18 משימת תרגום חדשות (Junczys-Dowmunt 2018b). השתמשנו בגרסאות משופרות של גישה זו במערכות הייצור ששיחררו היום.

ייצוג של word

בעת העברת טכנולוגיית המחקר לייצור, מספר אתגרים בעולם האמיתי להתעורר. קבלת מספרים, תאריכים, שעות, היוון, מרווח וכדומה, מתאים הרבה יותר בהפקה מאשר במערכת מחקר.

. שקול את האתגר של האותיות אם אנחנו מתרגמים את המשפט "שעון וידאו CAT כאן". אנחנו יודעים איך לתרגם "חתול". היינו רוצים לתרגם "CAT" באותו אופן. אבל עכשיו תחשיב. " אנחנו לא רוצים לבלבל את המילה "אנחנו" ואת ראשי התיבות "US" בהקשר זה.

כדי להתמודד עם זה, השתמשנו גישה המכונה תרגום מכונת המפעל (Koehn and ואנג 2007, סנווריץ וHaddow 2016) שעובד כדלקמן. במקום ייצוג מספרי בודד ("הטבעה") עבור "חתול" או "חתול", אנו משתמשים במעילה מרובות, המכונים "גורמים". במקרה זה, ההטבעה הראשית תהיה זהה עבור "CAT" ו-"cat", אך גורם נפרד ייצג את הרישיות, ומראה שהיה זה אותיות גדולות במופע אחד, אך האותיות הקטנות האחרות. גורמים דומים משמשים במקור ובצד המטרה.

אנו משתמשים בגורמים דומים כדי לטפל בקטעי מילים ובריווח בין מילים (בעיה מורכבת בשפות שאינן מרווחים או מרווחים למחצה, כגון סינית, קוריאנית, יפנית או תאילנדית).

הגורמים גם משופר באופן דרמטי תרגום של מספרים, אשר קריטי בתרחישים רבים. תרגום מספרים הוא בעיקר טרנספורמציה אלגוריתמית. לדוגמה, 1,234,000 ניתן לכתוב כ-12, 34000 בהינדית, 1.234.000 בגרמנית ו123.4 万 בסינית. באופן מסורתי, מספרים מיוצגים כמילים, כקבוצות של תווים באורך משתנה. זה מקשה על מחשב ללמוד לגלות את האלגוריתם. במקום זאת, אנו מאכילים כל ספרה אחת של מספר בנפרד, עם גורמים המציינים את ההתחלה והסוף. זה טריק פשוט מכבש ואמין הוסרו כמעט כל שגיאות מספר תרגום.

אימון מודל מהיר יותר

כאשר אנו מאמנים מערכת אחת לקראת מטרה אחת, כפי שעשינו עבור פרויקט מחקר זוגיות אנושית, אנו מצפים לזרוק מספר רב של חומרה במודלים שייקח שבועות להתאמן. כאשר הדרכה הייצור מודלים עבור 20 + זוגות השפה, גישה זו הופכת רופף. לא רק שאנו זקוקים לסיבוב הגיוני לפעמים, אך אנו גם צריכים לספק את דרישות החומרה שלנו. עבור פרוייקט זה, עשינו מספר שיפורים בביצועים כדי ל מריאן NMT (. ג'ונצ-דמונט ואח ' אל 2018b).

מריאן NMT היא ערכת הכלים העצבית של הקוד הפתוח המבוסס על מתרגם של Microsoft. מריאן היא טהורה כערכת התרגום של מכונת העצבים C++, ו, כתוצאה מכך, יעיל מאוד, לא דורש GPUs בזמן ריצה, יעיל מאוד בזמן האימון

בשל הטבע העצמי שלה, זה די קל לייעל מריאן עבור משימות ספציפיות NMT, אשר תוצאות אחד היעילים ביותר NMT toolkits זמין. תסתכל על ה חינות. אם אתה מעוניין MT מחקר ופיתוח העצבית, אנא הצטרפו ותורמים ל קהילה בגיתוב.

השיפורים שלנו בנוגע להדרכה ופענוח בדיוק מעורבים, כמו גם עבור הדרכה מודל גדול בקרוב יהיה זמין במאגר Github הציבור.

אנחנו נרגשים לגבי העתיד של תרגום מכונה עצבית. נמשיך לגלגל את ארכיטקטורת המודלים החדשה לשפות הנותרות ו מתרגם מותאם אישית במשך השנה. המשתמשים שלנו יקבלו באופן אוטומטי את התרגומים באיכות טובה יותר משמעותית דרך ה מתרגם APIשלנו תרגום app, Microsoft Office והדפדפן Edge. אנו מקווים שהשיפורים החדשים יסייעו לחיים האישיים והמקצועיים שלך ולצפות למשוב שלך.

פניות

- . ג'ימי בה וריצ קארואנה 2014. האם רשתות דיפ באמת צריכות להיות עמוקות? מקדמות במערכות עיבוד מידע עצבי 27. . דפים 2654-2662 https://papers.nips.cc/paper/5484-do-deep-nets-really-need-to-be-deep

- Hany חסן, אנתוני אואה, צ'אנג צ'ן, וישאל צ'ארירי, ג'ונתן קלארק, כריסטיאן פדרמן, שואיונג הואנג, מרצ ג'ונצ-דמונט, ויליאם לואיס, מו לי, שוג לו, עניבה-יאן לו, רנצ'יאן-לאו, אראל טאן, הטאו קין, פרנק Seide, שו טן, פיי טיאן, Lijun Wu , שואנג-ג'י-וו, Yingce קסיה, דונגדונג ג'אנג, ז'רוי זאנג. מינג ז'או 2018. השגת זוגיות אנושית בסינית אוטומטית לאנגלית תרגום חדשות. http://arxiv.org/abs/1803.05567

- הוא, די ושיה, Yingce ו צ'ין, טאו ו-וואנג, ליאוויי ו-יו, נגחאי וליאו, עניבה יאן ואמא, ווי-יינג. 2016. למידה כפולה עבור תרגום מכונה. מקדמות במערכות עיבוד מידע עצבי 29. . דפים 820-828 https://papers.nips.cc/paper/6469-dual-learning-for-machine-translation

- . מרצ ג'ונצ-דמונט 2018a סינון אנטרופיה מותנית כפולה של תאגיד מקביל ורועש. הליכי הכנס השלישי בתרגום מכונה: ניירות משימה משותפים. . בלגיה, דפי 888-895 https://aclweb.org/anthology/papers/W/W18/W18-6478/

- . מרצ ג'ונצ-דמונט 2018b. Microsoft להגשת משימה לתרגום WMT2018 חדשות: איך למדתי להפסיק לדאוג ולאהוב את הנתונים. הליכי הכנס השלישי בתרגום מכונה: ניירות משימה משותפים. . בלגיה, דפי 425-430 https://www.aclweb.org/anthology/W18-6415/

- מרצ ג'ונצ-דמונט, קנת הת, הואנג, רומן גרונדקביץ ', אנתוני אואה. 2018a. מריאן: חסכוני באיכות גבוהה מכונת עצביים ב-C++. הליכי הסדנה השנייה בתרגום מכונה עצבית ודור. . מלבורן, אוסטרליה, דפי 129-135 https://aclweb.org/anthology/papers/W/W18/W18-2716/

- מרצ ג'ונצ'ייס-דמונט, רומן גרונדקביץ ', תומאש דווידאק, הייהואנג, קנת הת, טום נקקמן, פרנק סאמיד, אולריך גרמאן, אלהאם פיקרי אג'י, ניקולאי בוגגוצ'ב, אנדרה פ. טי מרטינס, אלכסנדרה ליבנה. 2018b. מריאן: תרגום מכונת עצבית מהירה ב-C++. הליכים של ACL 2018, הפגנות מערכת. . מלבורן, אוסטרליה, דפי 116-121 https://www.aclweb.org/anthology/P18-4020/

- . יון קים ואלכסנדר מ. ראש 2016. זיקוק ידע ברמת הרצף. בהליכים של 2016 ועידה על שיטות אמפיריים בעיבוד שפה טבעית, EMNLP 2016, אוסטין, טקסס, ארה ב, נובמבר 1-4, 2016, דפים 1317 – 1327. https://aclweb.org/anthology/papers/D/D16/D16-1139/

- . פיליפ קוהן, הייeu ואנג 2007. מודלים לתרגום במפעל. הליכי הועידה המשותפת של 2007 בשיטות אמפיריים בעיבוד שפה טבעית ולמידה חישובית בשפה טבעית (EMNLP-CoNLL). , פראג, צ'כיה. דפים 868-876 https://www.aclweb.org/anthology/D07-1091/

- . ריקו סנריץ ', בארי Haddow 2016. תכונות קלט לשונית שיפור תרגום מכונה עצבית. הליכי הכנס הראשון בתרגום מכונה: כרך א', עבודות מחקר. . ברלין, גרמניה, דפי 83-91 https://www.aclweb.org/anthology/W16-2209/

- ואסיאני, Ashish ושיר, נועם ופרמר, ניקי ואוסזקורזה, יעקב וג, ליון וגומז, איידן אן וקייזר, לוקסז ופולוסוחין, אילליה. 2017. תשומת לב היא כל מה שאתה צריך. מקדמות במערכות עיבוד מידע עצביות 30. . דפים 5998-6008 https://papers.nips.cc/paper/7181-attention-is-all-you-need