Приведення перекладу AI до EDGE пристроїв за допомогою Microsoft Перекладач

У листопаді 2016, Microsoft принесла користь AI-Powered машинного перекладу, AKA Нейромашинний переклад (NMT), розробникам і кінцевим користувачам, так. Минулий тиждень Microsoft принесла можливості NMT до краю хмари використовуючи NPU, AI-виділений процесор інтегрований в Мат 10, Останній флагманський телефон Huawe's. Новий чіп робить AI-Powered переклади доступні на пристрої навіть при відсутності доступу в Інтернет, що дозволяє системі виробляти переклади, якість яких нарівні з онлайновою системою.

Для досягнення цього прориву, дослідники та інженери з Microsoft і Huawei співпрацював в адаптації нейротрансляції в цьому новому обчислювальному середовищі.

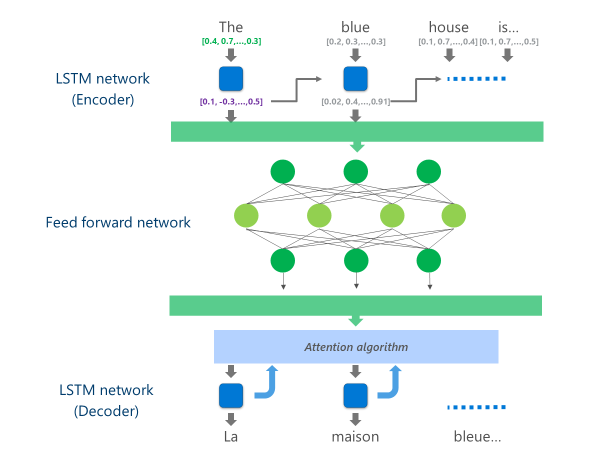

Найсучасніші системи NMT в даний час у виробництві (тобто, що використовуються в масштабі в хмарі по бізнесу і додатків), використовується Нейромережева архітектура, що об'єднує кілька шарів LSTM-мережі, алгоритм уваги, і шар перекладу (декодер).

Анімації нижче пояснює, в спрощеному вигляді, як це багатошарові нейронні мережі функції. Для більш детальної інформації, будь ласка, зверніться до "що таке сторінка машинного перекладу"на сайті перекладача Microsoft.

У цьому хмарному виконанні NMT ці середні шари LSTM споживають більшу частину обчислювальної потужності. Щоб мати можливість запускати повний NMT на мобільному пристрої, необхідно було знайти механізм, який може скоротити ці обчислювальні витрати при збереженні, як можна більше, якість перекладу.

Саме тут, нейронної процесор Huawe's (NPU) вступає в гру. Microsoft дослідників і інженерів скористалися NPU, яка спеціально інженерії для Excel на низьких затримки AI обчислень, для розвантаження операцій, які були б неприпустимо повільним для обробки на головному ПРОЦЕСОРІ.

Реалізації

Реалізація тепер доступна на додаток Microsoft перекладач для Huawei Mate 10 оптимізує переклад шляхом розвантаження найбільш обчислювальних завдань на НПУ.

Конкретно Ця реалізація замінює ці середні LSTM-шари мережі глибоким fEED-вперед нейронної мережі. Глибокі Нейромережеві нейронні мережі є потужними, але вимагають дуже великих обсягів обчислень завдяки високій зв'язності між нейронами.

Нейронні мережі покладаються головним чином на матричні багатокацій, операція, яка не є складною з математичною точки зору, але дуже дорого, коли виконується в масштабі, необхідного для такої глибокої нейронної мережі. Huawei НПУ виділяється у виконанні цих матричних мультикацій в масово паралельному моді. Крім того, досить ефективно з точки зору використання енергії, важлива якість на батарейках пристроїв.

На кожному шарі цієї мережі, NPU обчислює як сировину вихід нейрона, так і наступні Функція активації ReLu ефективно і з дуже низькою латентністю. Використовуючи достатню високошвидкісної пам'яті на НПУ, він виконує ці розрахунки паралельно без необхідності платити витрати на передачу даних (наприклад, уповільнення продуктивності) між ПРОЦЕСОРОМ і НПУ.

Після того, як остаточний шар цієї глибокої мережі вперед розраховується, система має багату представленість вихідного мовного речення. Це представлення потім подається через лівий-правий LSTM "декодер" для виробництва кожної цільової мови слово, з тим же алгоритмом уваги, що використовується в онлайн-версії NMT.

Як Ентоні Aue, головний інженер з розробки програмного забезпечення в команді Microsoft Перекладач пояснює: "приймаючи систему, яка працює на потужних серверах хмара в центрі даних і запускати його незмінним на мобільний телефон не є життєздатним варіантом. Мобільні пристрої мають обмеження в обчислювальному потужності, пам'яті та енергоспоживання, що хмарні рішення не мають. Маючи доступ до НПУ, поряд з деякими іншими архітектурними Tweaks, дозволили нам обійти багато хто з цих обмежень і розробити систему, яка може працювати швидко і ефективно на пристрої без компромісу якість перекладу."

Реалізація цих моделей перекладу на інноваційні чіпсета NPU дозволило Microsoft і Huawei доставити на пристрій нейронні перекладу на якість порівнянна з хмарними системами, навіть якщо ви перебуваєте поза сіткою.